负载均衡的工作原理是通过分散网络负载,提高系统的整体性能和可靠性。它根据当前的网络流量、服务器性能等条件,智能地将请求分配给最合适的服务器处理。负载均衡采用多种技术,如DNS负载均衡、特定服务软件的负载均衡策略以及硬件负载均衡等。其核心在于智能分配和调度,确保系统资源得到高效利用,提高访问速度,增强系统的可扩展性和稳定性。

本文目录导读:

随着互联网技术的飞速发展,网络应用面临着巨大的流量压力,为了提高系统的稳定性和性能,负载均衡技术应运而生,本文将详细介绍负载均衡的工作原理及其在各个领域的应用。

负载均衡概述

负载均衡是一种网络架构技术,旨在优化网络资源的分配,提高系统的可靠性和性能,通过负载均衡,可以将网络请求分散到多个服务器或资源上,从而实现资源的均衡利用,负载均衡技术广泛应用于云计算、数据中心、大型网站等领域。

负载均衡的工作原理

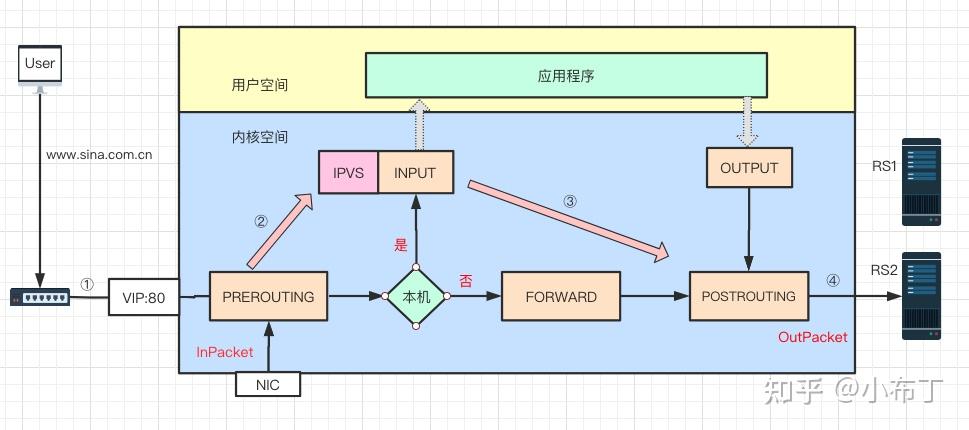

负载均衡的工作原理主要包括以下几个步骤:

1、监测流量:负载均衡器会实时监测网络流量,包括请求的数量、类型、来源等,这些信息对于后续的决策至关重要。

2、决策分配:根据监测到的流量信息,负载均衡器会按照一定的算法(如轮询、权重等)决定将请求分配给哪台服务器,这个决策过程需要考虑到服务器的性能、负载情况、地理位置等因素。

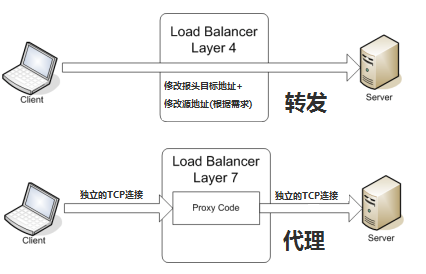

3、请求转发:一旦做出决策,负载均衡器会将请求转发到相应的服务器上,这个过程需要保证请求能够在最短的时间内到达目标服务器,并且保持高效的连接。

4、实时监控与调整:负载均衡器会实时监控服务器的性能和数据流量,根据实际情况调整分配策略,以确保系统的整体性能。

负载均衡的主要技术

1、DNS负载均衡:通过DNS域名系统的随机分配功能,将请求分散到多个IP地址上,这种方式简单易行,但无法实现精细的流量控制。

2、HTTP重定向负载均衡:通过HTTP重定向的方式,将请求引导到不同的服务器上,这种方式可以实现一定程度的流量分配,但对于实时性要求较高的情况可能不够理想。

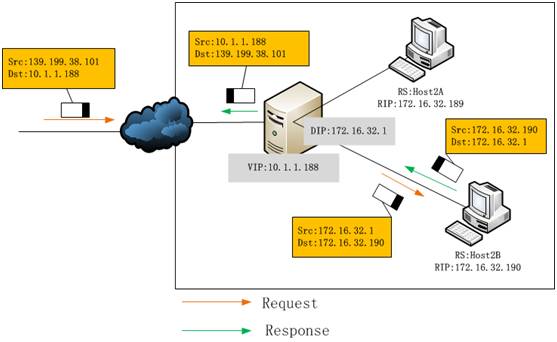

3、IP负载均衡:通过识别客户端的IP地址,将请求分配给特定的服务器,这种方式可以实现较为精确的流量控制,但需要维护IP地址与服务器之间的映射关系。

4、数据中心负载均衡:在数据中心内部,通过硬件或软件的方式实现流量的均衡分配,这种方式可以充分利用数据中心的各种资源,提高系统的整体性能。

负载均衡的应用场景

1、云计算:云计算平台需要处理大量的请求和数据,负载均衡技术可以有效地分配资源,提高云计算系统的性能和稳定性。

2、数据中心:数据中心内部需要实现服务器之间的流量均衡,以提高整体性能和资源利用率,负载均衡技术可以帮助数据中心实现这一目标。

3、大型网站:大型网站面临着巨大的流量压力,负载均衡技术可以分散请求,提高网站的访问速度和稳定性。

4、高性能计算:在高性能计算领域,负载均衡技术可以确保计算任务在多个计算节点之间均衡分配,提高计算效率。

负载均衡的挑战与未来发展

虽然负载均衡技术在许多领域已经得到了广泛应用,但仍面临着一些挑战,如何实时准确地监测和预测流量变化、如何优化分配策略以提高系统性能等,随着人工智能和机器学习技术的发展,负载均衡技术有望实现更智能的决策和更高效的资源分配,随着边缘计算的兴起,负载均衡技术在边缘计算领域的应用也将成为未来的研究热点。

负载均衡是一种重要的网络技术,通过优化资源分配提高系统的性能和稳定性,本文详细介绍了负载均衡的工作原理、主要技术、应用场景以及挑战与未来发展,随着技术的不断进步,负载均衡将在更多领域发挥重要作用。

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号

还没有评论,来说两句吧...